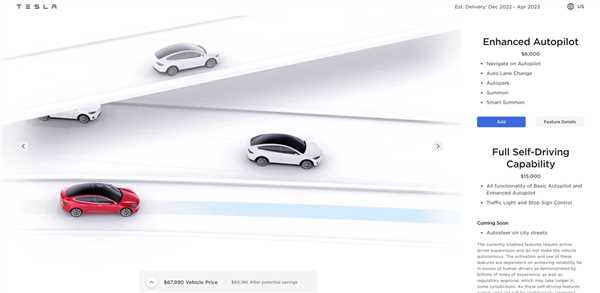

Автопилот Tesla Full Self-Driving (FSD) – это одно из самых инновационных решений в сфере автономных транспортных средств. Он позволяет автомобилю двигаться без участия человека, основываясь на комплексной системе видеокамер, радаров и датчиков.

Однако, несмотря на все технологические прорывы, возникают проблемы и жалобы со стороны владельцев автомобилей Tesla, использующих FSD. Пользователи охвачены возмущением, когда автопилот выдаёт ошибочные команды, неадекватно воспринимает дорожные ситуации или не может распознать некоторые объекты на дороге.

Проблемы с автопилотом Tesla FSD

Одной из главных проблем является недостаточная точность системы распознавания объектов. Владельцы автомобилей Tesla возмущены тем, что автопилот не всегда определяет препятствия на дороге, включая другие автомобили, пешеходов и посторонние объекты. Это может привести к опасным ситуациям на дороге и потенциальным авариям.

Еще одной проблемой, о которой жалуются владельцы Tesla, является непредсказуемое поведение автопилота в определенных ситуациях.

Технологические недоработки автопилота

Одной из наиболее часто упоминаемых проблем являются ложные срабатывания системы распознавания объектов. Автопилот иногда может неправильно идентифицировать преграды на дороге или другие автомобили, что может привести к неправильным действиям системы или даже авариям.

Еще одной недоработкой является ограниченная способность системы выявления и предотвращения опасных ситуаций. Некоторые владельцы сообщают, что автопилот не всегда реагирует на малозаметные преграды, такие как камни или ветви на дороге, что может стать опасным для безопасности пассажиров и окружающих.

Еще одной проблемой, связанной с технологическими недоработками, является отсутствие способности системы адаптироваться к различным дорожным условиям. Некоторые пользователи отмечают, что автопилот не всегда учитывает строительные работы, временные дорожные знаки или другие изменения на дороге, что может привести к непредвиденным ситуациям и проблемам с безопасностью.

Также широко обсуждаются проблемы с обновлениями программного обеспечения автопилота. Некоторые владельцы жалуются на то, что обновления не всегда улучшают работу системы или добавляют новые функции, а иногда даже приводят к ухудшению производительности автопилота.

В целом, технологические недоработки автопилота Tesla FSD являются важными аспектами, которые могут повлиять на безопасность и удобство использования системы. Однако, с учетом постоянного развития и улучшения технологий, можно ожидать, что эти проблемы будут решены в ближайшем будущем.

Частые аварии и несчастные случаи

Автоматический пилот Tesla FSD вызывает большую тревогу среди покупателей и общественности из-за частых аварий и несчастных случаев. Многие владельцы автомобилей Tesla, использующих автопилот, сообщают о неконтролируемых ситуациях на дороге и сбоях системы.

Несмотря на заявления Илона Маска о полной автономии и безопасности автоматического пилота, факты говорят об обратном. В прошлом было несколько серьезных аварий, связанных с работой автопилота Tesla FSD. В некоторых случаях это приводило к тяжелым травмам и даже смерти пассажиров и пешеходов.

Владельцы Tesla жалуются на то, что система автопилота может неправильно распознавать объекты на дороге, неадекватно реагировать на ситуации, неправильно менять полосу движения и нарушать правила дорожного движения. Это создает опасность для водителей и окружающих.

Несчастные случаи, связанные с автоматическим пилотом Tesla FSD, наносят удар по репутации компании и вызывают серьезные вопросы у потенциальных покупателей. Многие считают, что система требует дополнительных улучшений и испытаний, прежде чем она будет готова к использованию на дорогах.

В свете этих проблем и жалоб, Илон Маск обязан предоставить точные ответы и планы действия для устранения недостатков автоматического пилота Tesla FSD. Это позволит улучшить безопасность на дорогах и восстановить доверие к технологии автопилота.

Проблемы с распознаванием дорожных знаков

Одна из основных проблем, с которыми сталкиваются владельцы автомобилей Tesla с функцией автопилота FSD (Full Self-Driving), связана с неправильным распознаванием дорожных знаков. Пользователи сообщают о случаях, когда система не распознает знаки ограничения скорости, запрета обгона или другие необходимые указания, что может привести к нарушению ПДД и созданию аварийной ситуации.

Проблема с распознаванием дорожных знаков может быть вызвана несколькими факторами. Во-первых, система автопилота Tesla FSD основана на нейронных сетях и алгоритмах машинного обучения, которые не всегда могут корректно обрабатывать изображения дорожных знаков с высокой точностью. В дополнение, некорректная интерпретация знаков может происходить из-за ошибок в базе данных, которая используется для обучения системы распознавания знаков.

Кроме того, проблема может возникнуть из-за неоптимальных условий для распознавания знаков. Например, плохая видимость из-за погодных условий или загрязнение знаковых стоек могут затруднять правильное определение знаков автопилотом Tesla. Также, некоторые знаки могут быть неправильно установлены или повреждены, что также приводит к ошибкам в их распознавании.

В целом, проблемы с распознаванием дорожных знаков — это одна из сложностей, с которыми сталкиваются системы самостоятельного движения. Высокая степень точности и надежности при распознавании знаков является критически важной для безопасности и эффективности работы автопилота Tesla FSD, поэтому владельцы и общество в целом ожидают дальнейшего развития и совершенствования данной технологии.

Чувствительность системы к погодным условиям

Многие владельцы Tesla FSD также отмечают, что система не всегда корректно реагирует на лужи, а иногда даже путает их с препятствиями на дороге. Это может создавать опасную ситуацию, особенно при высокой скорости движения.

Кроме того, пользователи жалуются, что система не всегда учитывает гололедицу и другие непредвиденные условия на дороге. В таких случаях автопилот может неадекватно реагировать на рулевые команды и принимать решения, которые могут поставить под угрозу безопасность пассажиров и окружающих.

Илона Маска обратил внимание на эти жалобы и обещал улучшить чувствительность системы к погодным условиям в будущих версиях программного обеспечения. Однако пока пользователи остаются недовольными и предпочитают не полагаться полностью на автопилот в плохую погоду.

Недостаточная надежность системы предупреждения о преградах

Это создает серьезные проблемы и угрозы безопасности, так как водители полагаются на систему автопилота и ожидают, что она будет надежно предупреждать о преградах на пути. Однако, ситуации, когда система неоправданно доверяет водителю и не предупреждает о возможных аварийных ситуациях, приводят к подавленности и разочарованию клиентов.

Проблема недостаточной надежности системы предупреждения о преградах в автопилоте Tesla FSD очень серьезна и требует срочного решения. Владельцы автомобилей Tesla ожидают, что компания займется этой проблемой и предоставит им более надежную систему, которая будет предупреждать о преградах на дороге.

Кроме того, необходимо провести дополнительные испытания и проверить работу системы предупреждения о преградах в различных ситуациях и условиях на дороге. Только так можно обеспечить высокую надежность и безопасность функционала автопилота Tesla FSD.

Система автопилота Tesla FSD обладает большим потенциалом, однако, недостаточная надежность системы предупреждения о преградах остается серьезной проблемой, которую необходимо решить.

Претензии к качеству штатного программного обеспечения

Многие пользователи жалуются на постоянные сбои и ошибки в работе автопилота. Иногда система неправильно распознает дорожные знаки, сигналы светофоров, архитектурные объекты, что может привести к опасным ситуациям на дороге. Также частыми проблемами являются неправильная локализация автомобиля, ошибочные решения водителя, например, изменение полосы движения без необходимости или проезд через красный свет.

Одной из главных проблем также является то, что функционал автопилота не всегда соответствует заявленным возможностям. Многие пользователи ожидают, что автомобиль будет способен самостоятельно проехать от одного пункта до другого без вмешательства водителя, однако на самом деле автопилот требует постоянного наблюдения и готовности к реакции в случае аварийной ситуации.

Кроме того, качество обновлений и исправлений для автопилота также вызывает недовольство. Часто обновления содержат ошибки и ухудшают работу системы, а не улучшают её. Также некоторые исправления могут затрагивать другие функции автомобиля или вызывать сбои в работе других систем.

В связи с этим, многие владельцы Теслы выражают своё недовольство качеством штатного программного обеспечения и требуют от компании Tesla Motors более ответственного подхода к проблемам автопилота и регулярным обновлениям.

Проблемы с видеорегистраторами в транспорте Tesla

Видеорегистраторы в автомобилях Tesla предназначены для записи видео в случае несчастных случаев или аварийных ситуациях. Они могут быть полезными для определения причины аварийы, но, увы, не всегда исправно работают.

Один из основных недостатков видеорегистраторов в автомобилях Tesla заключается в том, что они не сохраняют данные видео на долгое время. Обычно видеозаписи хранятся всего около 10 минут и удаляются автоматически. Кроме того, видеорегистраторы могут быть неактивными на время зарядки автомобиля или при работе с автопилотом, что ограничивает их возможности.

Это вызывает неприятные ощущения у владельцев автомобилей Tesla, поскольку возникает ряд проблем в случае необходимости предоставить записи видеорегистраторов в качестве доказательства в спорных ситуациях на дороге или при возникновении страховых случаев.

К сожалению, на данный момент Tesla не предоставляет возможности для расширения функциональности и продления срока хранения записей видеорегистраторами. Это может привести к серьезным проблемам для владельцев автомобилей Tesla при возникновении спорных ситуаций или несчастных случаев на дороге.

Эта проблема обозначена множеством пользователей Tesla, и они выразили надежду на то, что Tesla улучшит функциональность видеорегистраторов и предоставит возможность сохранения видеозаписей на дольше время. Однако, пока эта проблема остается актуальной для владельцев автомобилей Tesla.

| Проблема | Причина | Возможные решения |

|---|---|---|

| Короткое время хранения записей видеорегистратора | Ограничения на производительность системы | Увеличение срока хранения данных |

| Неактивность видеорегистраторов во время зарядки или работы с автопилотом | Ограничения программного обеспечения | Исправление программного обеспечения для активации видеорегистраторов |

Нарушение законодательства и этических норм автопилотом

Автопилот Tesla FSD неоднократно стал объектом критики и возмущений из-за своей способности нарушать законодательство и этические нормы.

Одной из основных проблем, связанных с автопилотом Tesla, является его неспособность полностью соблюдать Правила дорожного движения. Система FSD, несмотря на прогресс в разработке, все еще допускает множество ошибок, связанных с распознаванием дорожных знаков, сигнализации и передвижения по разметке.

Это может приводить к серьезным последствиям, таким как возникновение аварий, нарушение скоростных режимов, проезд на красный свет и другие правонарушения. Несоблюдение Правил дорожного движения представляет угрозу для безопасности не только водителя автомобиля Tesla, но и других участников дорожного движения.

Кроме того, множество жалоб связано с поведением автопилота в нестандартных ситуациях. Зачастую система не распознает опасности, не справляется с неожиданными маневрами других водителей или не может правильно интерпретировать дорожную обстановку. Это может приводить к рисковым ситуациям и непредсказуемым последствиям.

Более того, владельцы Tesla обнаружили, что автопилот не всегда справляется с определением и учетом сложных этических ситуаций на дороге. Например, система может предпочесть столкновение с преградой перед подачей на ее избегание, если это другое ТС, поскольку сохранение жизней пассажиров автомобиля приходит на первое место.

Использование автопилота Tesla FSD без необходимой осведомленности и осторожности не только нарушает законодательство, но и создает опасность для всех участников дорожного движения. Это подтверждается многочисленными инцидентами, авариями и травмами, которые произошли в результате неправильного функционирования системы FSD.

Тесла и Илон Маск предоставляют все больше и больше возможностей для автономного вождения, однако без революции в технологиях и измениях законодательства эти возможности приносят больше проблем, чем пользы.

| Проблема | Последствия |

|---|---|

| Неспособность соблюдать Правила дорожного движения | Аварии, нарушение скоростных режимов, правонарушения |

| Неадекватное поведение в нестандартных ситуациях | Рисковые ситуации, непредсказуемые последствия |

| Неспособность правильно интерпретировать дорожную обстановку | Риск аварий и травматических ситуаций |

| Неправильная оценка сложных этических ситуаций | Опасность для всех участников дорожного движения |

Ответственность компании Tesla за происшествия на автопилоте

Компания Tesla, в лице главы Илона Маска, утверждает, что автопилот находится еще на стадии развития и его использование требует особой осторожности со стороны водителя. Все автомобили Tesla, оснащенные системой автопилота FSD, предупреждают водителя о необходимости быть готовыми к мгновенному вмешательству в процесс управления, даже если автомобиль движется самостоятельно.

Однако, несмотря на предупреждения и требования к водителю, на протяжении последних лет было зарегистрировано несколько серьезных происшествий, в которых участвовали автомобили Tesla на автопилоте. Эти происшествия вызвали волну возмущения и запросов к компании Tesla по поводу ответственности за эти случаи.

Проблемы с распознаванием объектов и ситуаций

Одной из основных претензий к системе автопилота Tesla FSD является недостаточная точность и надежность ее работы в условиях дорожного движения. Водители жалуются на то, что автомобиль не всегда верно распознает объекты и ситуации на дороге, включая другие автомобили, пешеходов и предметы. Это может привести к опасным ситуациям и авариям, когда автопилот не реагирует на препятствие во время движения.

Проблемы с вмешательством водителя

Водители также высказывают опасения относительно способности системы автопилота Tesla FSD предотвращать возникновение опасных ситуаций и аварий. Они замечают, что автомобиль не всегда отслеживает движение других транспортных средств и не реагирует на их действия вовремя. Вследствие этого водителям требуется быстро вмешаться в процесс управления для предотвращения столкновения.

В свете данных проблем и случаев происшествий пользователи требуют от компании Tesla более ответственного и активного подхода к разработке и обновлению системы автопилота FSD. Они желают, чтобы компания регулярно обновляла ПО и улучшала алгоритмы распознавания объектов и принятия решений, чтобы минимизировать возможность происшествий и повысить безопасность использования автопилота.

Компания Tesla должна взять на себя ответственность за происшествия, которые происходят на автопилоте, и представить общественности более прозрачную информацию о том, как работает система FSD и какие меры предпринимаются для ее улучшения. Это поможет наладить доверие к автопилоту и защитит пользователей от возможных рисков при использовании данной функции.

Критика автопилота со стороны других автопроизводителей

Автопилот Tesla FSD вызывает немало критики со стороны других автопроизводителей, которые считают его недостаточно безопасным и недоработанным. Очень часто упоминается следующее:

1. Отсутствие поддержки сторонних систем

Многие производители автомобилей поддерживают использование различных дополнительных систем, таких как радары, камеры и сенсоры других производителей. Тесла FSD, в свою очередь, не предоставляет такой возможности, предлагая только свою интегрированную систему. Это ограничивает автопроизводителей, которые хотели бы использовать более разнообразные технологии для разработки автопилотов.

2. Отсутствие достаточной надежности

Система автопилота Tesla FSD постоянно обновляется по мере поступления новых данных и опыта от огромного количества автомобилей. Тем не менее, многие автопроизводители считают, что эта система еще не достаточно надежна и требует дальнейших улучшений. Критики указывают на несколько случаев, когда Tesla была вовлечена в серьезные аварии, связанные с использованием автопилота.

| Год | Авария | Причина |

|---|---|---|

| 2016 | Смерть водителя Model S | Необнаружение полуприцепа на дороге |

| 2018 | Смерть водителя Model X | Необнаружение бетонной стены на дороге |

| 2020 | Смерть водителя Model 3 | Пересечение двух дорог на большой скорости |

Эти случаи вызывают серьезные сомнения в том, насколько автопилот Tesla FSD действительно безопасен и надежен.

В целом, критика со стороны других автопроизводителей указывает на необходимость дальнейшего развития и совершенствования системы автопилота Tesla FSD для обеспечения максимальной безопасности и надежности на дороге.

Негативное влияние рассказов Маска на свободу слова

Высказывания Илона Маска о проблемах и жалобах на автопилот Tesla FSD имеют негативное влияние на свободу слова в сообществе.

Во-первых, Маск, будучи крупнейшим акционером и CEO Tesla, обладает большим влиянием и публичной позицией. Его слова могут быть восприняты как официальная позиция компании и влиять на решения автопроизводителей, регулирующие органы и потребителей. Это может привести к ограничению свободы слова других сторон и подавлению неудобной информации о проблемах с автопилотом.

Во-вторых, высказывания Маска о проблемах с автопилотом могут вызывать тревогу среди пользователей и создавать напряженность в сообществе. Это может привести к самоцензуре и ограничению свободы собственного мнения, поскольку пользователи могут бояться получить негативную реакцию со стороны сообщества.

Кроме того, рассказы Маска о проблемах с автопилотом могут отрицательно отразиться на репутации Tesla и ее способности привлекать инвестиции. Это может привести к ограничению свободы слова внутри компании и ограничению доступа к средствам коммуникации.

В целом, высказывания Маска о проблемах и жалобах на автопилот Tesla FSD могут иметь негативное влияние на свободу слова в сообществе и привести к самоцензуре и ограничению свободы выражения своего мнения.

Гнев потребителей и западных регуляторов против Илона Маска

Автопилот Tesla FSD, разработанный Илоном Маском, вызвал серьезные проблемы и возмущение как среди потребителей, так и у западных регуляторов. Возможности автоматического вождения электромобилей Tesla, обещанные Маском, не только не оправдали ожиданий, но и привели к нескольким серьезным происшествиям.

Проблемы с безопасностью

Одной из главных проблем автопилота Tesla FSD является его низкая эффективность и опасность при эксплуатации. Регулярно появляются сообщения о том, что система не распознает препятствия на дороге или неправильно реагирует на опасные ситуации. Это может привести к авариям и серьезным последствиям для пассажиров и окружающих.

Западные регуляторы также выразили свое возмущение по поводу безопасности автопилота Tesla FSD. Несмотря на то, что Маск утверждает, что система является практически полностью автономной и может заменить водителя, регуляторы опасаются, что это ведет к небезопасной эксплуатации и возможным происшествиям на дорогах.

Низкое качество и плохая поддержка

Помимо безопасности, многие пользователи также жалуются на низкое качество и плохую поддержку системы. Множество ошибок и сбоев программного обеспечения приводят к неправильной работе автопилота и неудовлетворительному опыту вождения. Кроме того, Tesla не предоставляет должной поддержки своим клиентам, не реагирует на жалобы и проблемы, что только усиливает негативное отношение потребителей к компании и Илону Маску лично.

В итоге, гнев потребителей и возмущение западных регуляторов против Илона Маска и его автопилота Tesla FSD стали неотъемлемой частью обсуждений в автомобильной и технологической отраслях. Недовольство возникает из-за проблем с безопасностью системы и недостаточного качества работы, а также из-за плохой поддержки со стороны производителя.

Необходимо серьезное усовершенствование автопилота Tesla FSD, чтобы обеспечить безопасность и надежность системы. Поддержка клиентов также должна быть улучшена, чтобы удовлетворить требования и ожидания потребителей.

Илону Маску предстоит принять меры, чтобы обратить внимание на проблемы и преодолеть гнев потребителей и западных регуляторов. В противном случае, дальнейшая эффективность и успех компании Tesla могут быть серьезно подорваны.